Les récentes avancées en intelligence artificielle ont ouvert des voies innovantes pour la création de contenus numériques, notamment dans les secteurs du cinéma et de la robotique. Des chercheurs de renommée internationale ont développé un nouveau cadre capable de générer des vidéos de mouvements humains à partir de simples instructions textuelles, un défi longtemps considéré comme ardu.

HUMANIZE : la base du nouveau modèle

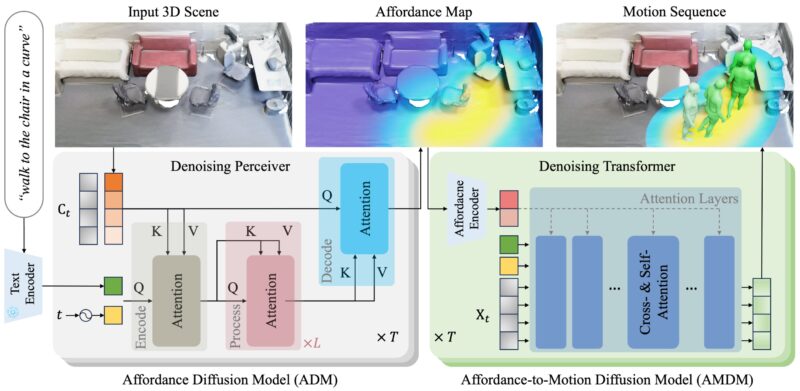

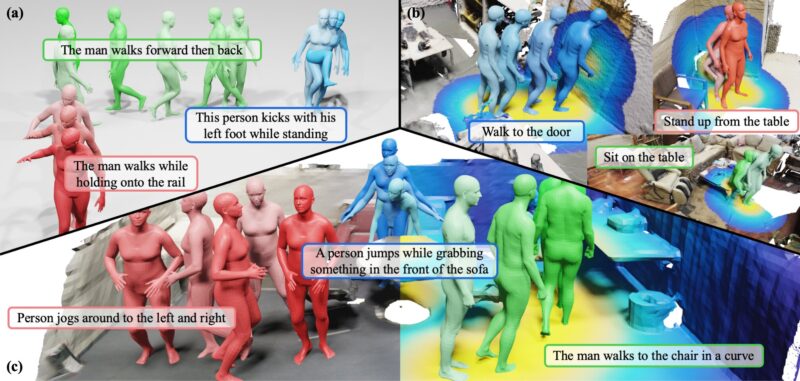

Le projet, intitulé HUMANIZE, repose sur une approche en deux étapes améliorant significativement la génération de mouvements humains en 3D. Selon Yixin Zhu, co-auteur de l'étude, cette méthode permet une interaction plus naturelle entre le langage humain et les mouvements générés par l'IA, en s'appuyant sur les données de la scène pour une meilleure précision.

« Les premières expériences de notre travail précédent, HUMANIZE , ont indiqué qu'un cadre en deux étapes pourrait améliorer la génération de mouvements humains guidée par le langage dans les scènes 3D, en décomposant la tâche en mise à la terre de la scène et génération de mouvements conditionnels », a déclaré Yixin Zhu.

Amélioration des capacités de généralisation

Les chercheurs ont également travaillé sur la capacité de l'IA à généraliser à partir de situations déjà apprises à des situations nouvelles. Par exemple, après avoir appris à générer un mouvement humain pour « s'allonger sur le lit », l'IA peut maintenant simuler « s'allonger sur le sol ». Siyuan Huang, co-auteur, explique que cela est possible grâce à un modèle de prédiction des possibilités d'action (affordance) et un modèle de diffusion qui transforme ces données en mouvements humains.

« Notre méthode se déroule en deux étapes : un modèle IA de diffusion d'affordance (ADM) pour la prédiction de la carte d'affordance et un modèle de diffusion d'affordance-to-motion (AMDM) pour générer le mouvement humain à partir de la description et de l'affordance pré-produite », a expliqué Siyuan Huang.

Avantages du nouveau cadre

Le cadre introduit offre plusieurs avantages par rapport aux techniques précédentes, notamment une meilleure capacité à interpréter et utiliser l'espace 3D à partir de descriptions textuelles. Wei Liang, également co-auteur, souligne que les modèles exploitent une compréhension approfondie des interactions entre les scènes et les mouvements humains. Ce qui permet une meilleure généralisation à travers différentes géométries de scènes.

Impact futur et applications possibles

Cette innovation pourrait révolutionner la production de films d'animation et la création de bases de données pour la formation robotique. Cette prouesse peut offrir des animations plus réalistes et efficaces. Les chercheurs envisagent déjà des améliorations futures, notamment en optimisant la collecte et l'annotation des données d'interaction entre l'homme et la scène pour renforcer la praticité du modèle.

En somme, l'initiative HUMANIZE de l'Institut de technologie de Pékin, en collaboration avec BIGAI et l'Université de Pékin, promet de marquer un tournant dans la recherche sur l'IA générative et ses applications. Cet exploit rend les interactions homme-machine encore plus naturelles et intuitives.